Numérique et Sciences Informatiques > Intelligence Artificielle (Notions de Base) > Éthique de l'IA > Biais algorithmiques

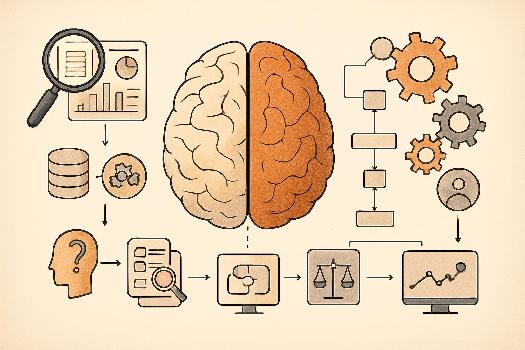

Introduction aux biais algorithmiques : Comprendre et identifier les biais dans l'IA

Explorez les biais algorithmiques : comment ils se manifestent, leurs sources et comment les identifier dans les systèmes d'intelligence artificielle.

Qu'est-ce qu'un biais algorithmique ?

Un biais algorithmique se produit lorsqu'un algorithme produit des résultats systématiquement injustes ou discriminatoires. Ce n'est pas une erreur aléatoire, mais une tendance prévisible qui favorise certains groupes au détriment d'autres. Ces biais peuvent affecter de nombreux domaines, de la justice pénale à l'emploi en passant par la santé.

Imaginez un algorithme utilisé pour évaluer des candidatures d'emploi. Si cet algorithme a été entraîné sur des données historiques où les postes de direction étaient majoritairement occupés par des hommes, il pourrait, par biais, accorder une préférence aux candidatures masculines, même si les candidates sont tout aussi, voire plus, qualifiées.

Pourquoi est-ce important ? Les biais algorithmiques peuvent renforcer les inégalités existantes et créer de nouvelles formes de discrimination, souvent sans que nous en soyons conscients.

Les sources des biais algorithmiques

Les biais algorithmiques ne sortent pas de nulle part. Ils proviennent principalement de trois sources principales :

- Données d'entraînement biaisées : C'est la source la plus courante. Si les données utilisées pour entraîner un algorithme ne sont pas représentatives de la population générale, l'algorithme reproduira et amplifiera ces biais. Par exemple, un système de reconnaissance faciale entraîné principalement sur des visages de personnes blanches aura du mal à identifier correctement les visages de personnes de couleur.

- Conception de l'algorithme : La manière dont un algorithme est conçu peut également introduire des biais. Les choix faits par les concepteurs concernant les fonctionnalités à prendre en compte, les pondérations attribuées à ces fonctionnalités et les critères d'évaluation peuvent tous influencer les résultats.

- Interprétation des résultats : Même si un algorithme est impartial, l'interprétation de ses résultats peut introduire des biais. Par exemple, si un algorithme prédit le risque de récidive d'un criminel, l'interprétation de ce risque peut être influencée par des stéréotypes sociaux.

Prenons un exemple concret : un algorithme utilisé pour prédire le risque de maladie cardiaque. Si les données d'entraînement proviennent principalement d'hommes, l'algorithme pourrait ne pas identifier correctement les facteurs de risque chez les femmes, conduisant à un diagnostic erroné.

Comment identifier les biais algorithmiques ?

Identifier les biais algorithmiques est un processus complexe, mais essentiel. Voici quelques techniques courantes :

- Analyse des données d'entraînement : Examinez attentivement les données utilisées pour entraîner l'algorithme. Sont-elles représentatives de la population générale ? Y a-t-il des groupes sous-représentés ou surreprésentés ?

- Tests de performance : Évaluez les performances de l'algorithme sur différents groupes démographiques. Y a-t-il des différences significatives dans la précision, le rappel ou d'autres métriques de performance ?

- Analyse des résultats : Examinez les résultats produits par l'algorithme dans des cas spécifiques. Y a-t-il des schémas de discrimination ou d'injustice ?

- Audits d'équité : Faites réaliser des audits d'équité par des experts indépendants pour évaluer l'impact de l'algorithme sur différents groupes.

Par exemple, lors du test d'un algorithme de reconnaissance faciale, il est crucial de vérifier si le taux d'erreur varie en fonction de l'origine ethnique des personnes.

Attention : L'absence de biais apparents ne signifie pas nécessairement qu'il n'y en a pas. Les biais peuvent être subtils et difficiles à détecter.

Exemples concrets de biais algorithmiques

Les biais algorithmiques sont présents dans de nombreux domaines :

- Recrutement : Algorithmes favorisant les candidatures masculines ou issues de certains établissements.

- Justice pénale : Systèmes prédisant le risque de récidive biaisés envers certaines communautés.

- Santé : Algorithmes de diagnostic médical moins performants pour certains groupes démographiques.

- Publicité : Annonces ciblées basées sur des stéréotypes sociaux.

Exemple : Un algorithme utilisé par Amazon pour le recrutement avait été entraîné sur des données historiques de l'entreprise, où la majorité des employés étaient des hommes. L'algorithme a fini par dévaloriser les CV contenant des mots associés aux femmes, reproduisant ainsi les biais existants.

Comment atténuer les biais algorithmiques ?

Il n'existe pas de solution miracle pour éliminer les biais algorithmiques, mais plusieurs stratégies peuvent aider à les atténuer :

- Collecter des données plus diverses : Assurez-vous que les données d'entraînement représentent fidèlement la population générale.

- Utiliser des techniques de débogage des données : Identifiez et corrigez les biais présents dans les données d'entraînement.

- Concevoir des algorithmes plus équitables : Utilisez des techniques de conception qui tiennent compte de l'équité.

- Surveiller les performances de l'algorithme : Évaluez régulièrement les performances de l'algorithme sur différents groupes démographiques et apportez les ajustements nécessaires.

- Impliquer des experts en éthique : Collaborez avec des experts en éthique pour identifier et atténuer les biais potentiels.

L'atténuation des biais est un processus continu qui nécessite une vigilance constante et une collaboration interdisciplinaire.

Ce qu'il faut retenir

Qu'est-ce qu'un biais algorithmique ? Une tendance systématique d'un algorithme à produire des résultats injustes ou discriminatoires.

Sources des biais :

- Données d'entraînement biaisées

- Conception de l'algorithme

- Interprétation des résultats

Comment les identifier ?

- Analyse des données d'entraînement

- Tests de performance sur différents groupes

- Analyse des résultats

- Audits d'équité

Comment les atténuer ?

- Collecter des données plus diverses

- Déboguer les données

- Concevoir des algorithmes plus équitables

- Surveiller les performances

- Impliquer des experts en éthique

Les biais algorithmiques sont un défi majeur dans le domaine de l'IA. Il est crucial de les comprendre et de les atténuer pour garantir que l'IA profite à tous.

FAQ

-

Un algorithme peut-il être complètement impartial ?

Il est extrêmement difficile, voire impossible, de créer un algorithme complètement impartial. Même avec des données parfaites, les choix faits lors de la conception de l'algorithme peuvent introduire des biais. L'objectif est de minimiser les biais et de s'assurer que l'algorithme ne discrimine pas injustement certains groupes. -

Qui est responsable des biais algorithmiques ?

La responsabilité des biais algorithmiques est partagée entre plusieurs acteurs : les concepteurs de l'algorithme, les collecteurs de données, les utilisateurs de l'algorithme et les décideurs qui s'appuient sur ses résultats. Tous doivent être conscients des risques de biais et prendre des mesures pour les atténuer.