Numérique et Sciences Informatiques > Intelligence Artificielle (Notions de Base) > Éthique de l'IA > Impact sur l'emploi

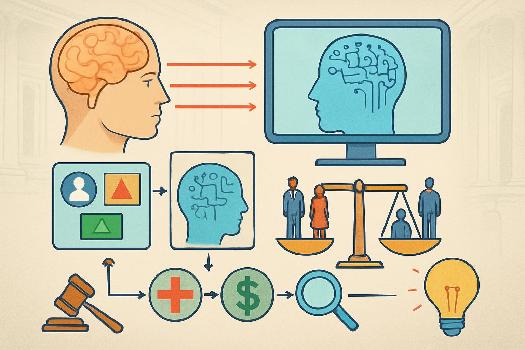

Biais dans l'Intelligence Artificielle: Origines, Conséquences et Solutions

Examinez les sources de biais dans les systèmes d'IA, leurs conséquences potentiellement néfastes et les stratégies pour les atténuer et garantir une IA plus équitable.

Introduction: Le problème des biais dans l'IA

L'intelligence artificielle (IA) est de plus en plus présente dans notre vie quotidienne, influençant nos décisions et nos interactions. Cependant, les systèmes d'IA ne sont pas neutres. Ils peuvent contenir des biais, c'est-à-dire des préjugés ou des discriminations, qui peuvent avoir des conséquences négatives sur les individus et la société.

Origines des biais dans l'IA

Les biais dans l'IA peuvent provenir de différentes sources :

- Données d'entraînement: Les systèmes d'IA apprennent à partir de données. Si ces données sont biaisées, l'IA reproduira et amplifiera ces biais. Par exemple, si un système de reconnaissance faciale est entraîné principalement avec des images de personnes blanches, il risque d'être moins performant pour reconnaître les personnes de couleur.

- Algorithmes: Les algorithmes utilisés pour construire les systèmes d'IA peuvent également introduire des biais. Par exemple, un algorithme peut être conçu pour favoriser un certain groupe de personnes par rapport à un autre.

- Concepteurs: Les biais des concepteurs de l'IA peuvent également influencer le développement des systèmes. Par exemple, un concepteur peut inconsciemment intégrer ses propres préjugés dans la conception de l'IA.

Conséquences des biais dans l'IA

Les biais dans l'IA peuvent avoir des conséquences néfastes dans de nombreux domaines :

- Emploi: Les systèmes d'IA utilisés pour le recrutement peuvent discriminer certains candidats en fonction de leur sexe, de leur origine ethnique ou de leur âge.

- Justice: Les systèmes d'IA utilisés dans le système judiciaire peuvent conduire à des décisions injustes, par exemple en matière de libération conditionnelle.

- Santé: Les systèmes d'IA utilisés pour le diagnostic médical peuvent être moins performants pour certaines populations, ce qui peut entraîner des erreurs de diagnostic.

- Finance: Les systèmes d'IA utilisés pour l'octroi de prêts peuvent discriminer certains groupes de personnes, les empêchant d'accéder au crédit.

Solutions pour atténuer les biais dans l'IA

Il existe différentes stratégies pour atténuer les biais dans l'IA :

- Collecte de données diversifiées: S'assurer que les données d'entraînement sont représentatives de la population concernée.

- Détection et correction des biais dans les données: Identifier et corriger les biais présents dans les données d'entraînement.

- Conception d'algorithmes équitables: Développer des algorithmes qui minimisent les risques de discrimination.

- Audit des systèmes d'IA: Évaluer régulièrement les systèmes d'IA pour détecter et corriger les biais.

- Transparence et explicabilité: Rendre les systèmes d'IA transparents et explicables, afin que l'on puisse comprendre comment ils prennent leurs décisions.

- Sensibilisation et formation: Sensibiliser les concepteurs et les utilisateurs de l'IA aux risques de biais et les former aux bonnes pratiques.

L'importance de l'éthique dans le développement de l'IA

La lutte contre les biais dans l'IA est un enjeu éthique majeur. Il est essentiel de s'assurer que l'IA est utilisée de manière responsable et qu'elle ne contribue pas à creuser les inégalités sociales. Cela implique de prendre en compte les aspects suivants :

- Justice et équité: L'IA ne doit pas être utilisée pour discriminer ou marginaliser certains groupes de personnes.

- Responsabilité: Les concepteurs et les utilisateurs de l'IA doivent être responsables de leurs actions.

- Transparence et explicabilité: Les systèmes d'IA doivent être transparents et explicables, afin que l'on puisse comprendre comment ils prennent leurs décisions.

Ce qu'il faut retenir

Les biais dans l'IA sont un problème sérieux qui peut avoir des conséquences néfastes. Il est essentiel de comprendre les origines de ces biais et de mettre en place des stratégies pour les atténuer. Les points clés à retenir sont :

- Les biais peuvent provenir des données d'entraînement, des algorithmes ou des concepteurs.

- Les biais peuvent avoir des conséquences négatives dans de nombreux domaines, tels que l'emploi, la justice, la santé et la finance.

- Il existe différentes stratégies pour atténuer les biais, telles que la collecte de données diversifiées, la conception d'algorithmes équitables et l'audit des systèmes d'IA.

- La lutte contre les biais dans l'IA est un enjeu éthique majeur.

FAQ

-

Qu'est-ce qu'un biais dans l'IA ?

Un biais dans l'IA est une préjugé ou une discrimination qui est intégré dans un système d'IA, soit par les données d'entraînement, soit par l'algorithme lui-même, soit par les concepteurs. -

Pourquoi est-il important de lutter contre les biais dans l'IA ?

Il est important de lutter contre les biais dans l'IA pour garantir que les systèmes d'IA sont utilisés de manière équitable et responsable, et qu'ils ne contribuent pas à creuser les inégalités sociales. -

Comment puis-je identifier les biais dans un système d'IA ?

Il peut être difficile d'identifier les biais dans un système d'IA, car ils peuvent être subtils et cachés. Cependant, il est possible de réaliser des audits des systèmes d'IA pour détecter et corriger les biais.